Varför din organisation behöver lära sig svamla

De flesta AI-verktyg bygger på ett dolt antagande: att du redan vet vad du vill ha innan du börjar. Du skriver en prompt. Du beskriver en uppgift. Du specificerar ett utfall. Verktyget levererar.

Det antagandet formar allt — gränssnittet, arbetsflödet, utbildningen. Och det har gjort en viss typ av yrkesperson systematiskt sämre på att använda AI: experten som tänker i tal, inte i skrift.

Röst-först inverterar antagandet. Det börjar med det du redan gör — beskriver, reflekterar, resonerar högt — och låter strukturen växa fram ur det. Men att invertera antagandet räcker inte på egen hand. Det som saknas är att lära människor att kalibrera vilket läge de befinner sig i när de producerar input. Den kalibreringen är en inlärbar kompetens. Det är också, i vår erfarenhet, kompetensen som skiljer organisationer som får bestående värde från AI från dem som fastnar i demos.

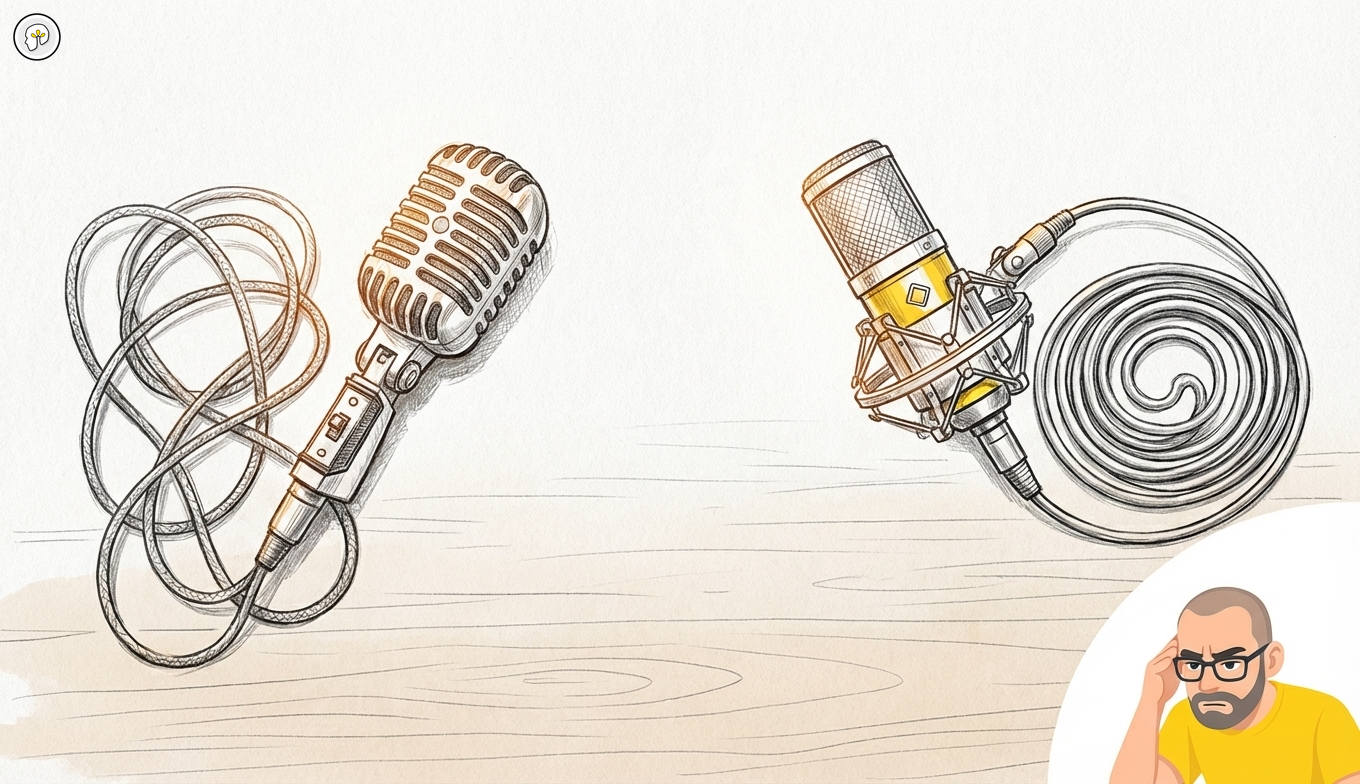

Två inputlägen — inte ett

Det finns en distinktion som nästan ingen AI-utbildning gör explicit, men som varje effektiv AI-praktiker utvecklar intuitivt.

Det första läget är vad vi kallar kladdigt — ostädat, ostrukturerat, fritt. Du har inget strikt mål. Du beskriver vad du försöker förstå, vad du sett, vad som förvirrar dig. Du låter AI tolka. Du välkomnar semantiska slutledningar, kontextuella antaganden, följdfrågor. Det här är läget för utforskning, för att fånga domänkunskap innan du vet hur du ska formalisera den, för att arbeta igenom ett problem du inte helt förstår ännu.

Det andra läget är krispigt eller knisprigt — precist, träffsäkert, riktat. Du vet exakt vad du vill ha. "Lägg till det här fältet." "Ta bort det här avsnittet." "Dela upp den här vyn per team." Ingen tolkning efterfrågad. AI tillämpar din instruktion precist, och varje avvikelse är ett fel, inte en funktion.

Knisprigt — ett ord myntat mitt i en mening av en praktiker som försökte beskriva det ögonblick när rörigt input plötsligt har form — fångar övergången mellan de två. Det är inte ett slutläge. Det är ögonblicket när du växlar växel.

Problemet de flesta organisationer har är inte att de saknar AI-verktyg. Det är att deras medarbetare hamnar i ett läge och tillämpar det överallt. Yrkespersoner som är bekväma med struktur ger krispiga instruktioner när de borde utforska — och får output som är precist fel. Yrkespersoner som föredrar samtal ger kladdig input när de behöver en specifik förändring — och skyller på verktyget för att det inte förstår dem.

Att lära ut kalibreringen är träningsinsatsen. Inte prompttips. Inte verktygshandledningar. Den faktiska kompetensen att veta vilket läge du befinner dig i och välja medvetet.

Varför text-först är bakvänt

Kunskapsarbetare tänker i tal, inte i skrift. Experten som spenderat tjugo år på att förstå en domän kommer, när hen ombeds beskriva sitt problem, att producera en muntlig förklaring som är rikare, snabbare och mer kontextuellt korrekt än vad de än skulle skriva i en prompt eller ett kravdokument.

Gapet mellan den talade och den skrivna versionen är inte trivialt. I skrift redigerar yrkespersoner innan de committar. De tar bort omvägarna, reservationerna, de halvformulerade nyanserna som representerar problemets faktiska komplexitet. De producerar något som ser rent ut men missar det som var mest relevant.

Röst fångar originalet. Sidospåret som började som ett tillägg och visade sig innehålla det egentliga kravet. Frasen "det måste vara snabbt" sagt med betoning på snabbt — vilket kommunicerar en prioritet som den skrivna frasen hade plattat ut helt. Pausen innan ett svar, som i sig självt är information.

Ett text-först arbetsflöde tvingar yrkespersoner att filtrera innan AI ens ser inputen. Röst-först låter AI arbeta med råmaterialet. Filtreringen sker efter extraktion, dirigerad av en människa som förstår domänen.

Det här är inte en arbetsflödespreferens. Det är en noggrannhetsskillnad.

Semantisk tolkning versus BI-verktyg

Standardargumentet mot ostrukturerat input är datakvalitetsproblemet. BI-verktyg kräver ren data. Innan du kan visualisera något måste data tvättas, struktureras och valideras. Det projektet kan ta månader, och när det väl är klart har kraven förändrats.

AI-semantisk tolkning tar bort det hindret. Den kräver inte att data struktureras mot ett förutbestämt schema. Den tolkar vad som finns. "Det här fältet verkar beskriva ärendetyp, även om det märks olika i olika projekt." "Dessa tre statusar verkar alla betyda 'väntar på någon annan'." Tolkningarna presenteras för validering — en domänexpert bekräftar eller korrigerar — och kontexten byggs upp iterativt.

Skiftet det möjliggör är inte bara hastighet. Det är en förändring av vilka frågor du kan ställa. Med BI-verktyg kan du bara visualisera vad din datastruktur var designad att exponera. Med semantisk tolkning kan du ställa frågor om mönster som din datastruktur aldrig förutsåg — för att AI läser för mening, inte för schemaöverensstämmelse.

En praktiker beskrev den traditionella ansatsen som "en evig resa mot ren data" — infrastrukturprojektet före infrastrukturprojektet. Semantisk AI-input eliminerar förutsättningen.

Human-in-the-loop är inte en funktion

Det finns en version av röst-först-argumentet som slutar med "och sedan gör AI allt." Den versionen är fel, och organisationer som tror på den kommer att producera säkra fel i stor skala.

Human-in-the-loop är inte en funktion du lägger till när saker går fel. Det är yrkesstandarden för att arbeta med AI-genererad output. Varje semantisk tolkning presenterad för en domänexpert för validering, varje sammanfattning granskad innan den vidarebefordras, varje output bedömd innan den driver ett beslut — det här är inte overhead. Det är arbetet.

AI fattar inte beslut. Det producerar output. Distinktionen är inte semantisk. När en AI-analys identifierar att ett visst statusövergångsmönster korrelerar med projektförseningar har den hittat ett mönster. Om det mönstret är kausalt, slumpmässigt eller en artefakt av datakvalitet — det är ett mänskligt omdöme, informerat av domänkunskap som AI inte har.

Organisationer som behandlar AI-output som beslut kommer så småningom att producera kostsamma misstag. Organisationer som behandlar AI-output som material för mänskligt omdöme får sammansatt värde: varje iteration förbättrar analysen, varje validering bygger ett mer exakt semantiskt sammanhang, varje beslut ägs av någon som förstår vad de beslutat.

Flaskhalsen är inte AI-kapacitet. Det är kvaliteten på det mänskliga omdömet som tillämpas på AI-output. Det är ett utbildningsproblem.

Det ärliga avsnittet om bekräftelsebias

Röst-först AI kan, om det används okritiskt, bekräfta vad du redan tror mer effektivt än något tidigare verktyg.

När du beskriver ett problem i kladdigt läge och AI återger en strukturerad tolkning, tenderar den tolkningen att matcha formen på din beskrivning. Om din beskrivning formades av en befintlig övertygelse om var problemet ligger, kommer AI-outputen att verka validera den övertygelsen. Det ser ut som insikt. Det kan vara projektion.

Det här är inte ett fel i ansatsen. Det är en strukturell risk i all analys, som röst-först AI accelererar. Motåtgärden är inte att sluta använda ostrukturerat input — det är att bygga in explicita valideringssteg och att odla vanan att fråga: är det här vad datan visar, eller är det vad jag redan förväntade mig?

En specifik disciplin som hjälper: när du granskar AI-output, generera minst en alternativ tolkning innan du accepterar den första. Om datan visar att arbete fastnar i granskning, fråga om det istället kan visa att vissa typer av arbete felklassificeras som fastnade när de faktiskt befinner sig i ett legitimt vänteläge. Om du inte kan generera ett alternativ har du inte letat tillräckligt noga.

Bekräftelsebias försvinner inte för att analysen var AI-assisterad. Den förstärks, för att outputen presenteras med strukturell säkerhet.

Organisatoriskt motstånd som signal

Det finns ett mönster vi ser i varje organisation som försöker datadrivet AI-arbete. Någon tittar på en tidig analys och säger: "Det där datat stämmer inte."

Den reaktionen handlar nästan aldrig om datan. Den handlar om gapet mellan vad datan visar och vad som tidigare troddes. Datan kan vara helt korrekt. Övertygelsen kan vara fel. Eller datan kan avslöja ett mönster som är sant men obekvämt — en flaskhals där en senior person arbetar, en fördröjning som implicerar en specifik process, en insikt som kräver att erkänna att ett tidigare beslut var fel.

"Det där datat stämmer inte" är en signal att undersöka, inte att avfärda. Undersökningen — att fråga vilka specifika poster som verkar felaktiga och hur korrekt skulle se ut — är ofta där det mest värdefulla arbetet sker. Det är ögonblicket där domänkunskap möter dataanalys, och där AI:s semantiska tolkningar förfinas av de människor som förstår vad siffrorna faktiskt representerar.

Att behandla det här motståndet som hinder missar vad det innehåller. Det innehåller den implicita modell människor använder för att förstå sitt arbete. Att göra den modellen explicit är poängen med hela övningen.

Svamla och knisprigt som inlärbar disciplin

Svamla — att tala fritt utan ett fast mål — är inte frånvaro av kompetens. Det är en kompetens som de flesta yrkesmiljöer systematiskt tränat bort från människor.

Kunskapsarbetaren som spenderat en karriär i möten vet att precision värdesätts och att svamla inte gör det. De har lärt sig att front-loada slutsatser, komprimera resonemang och utelämna omvägar. Det är användbara kompetenser i många sammanhang. I kladdigt AI-input är de skulder. Den komprimerade, förfiltrerade versionen av ett problem ger AI mindre att arbeta med, inte mer.

Att lära människor att svamla produktivt — att beskriva fritt med förståelsen att rikhet i input producerar rikhet i output — är omskolning, inte en verktygshandledning. Det kräver tillåtelse att vara oprecis, och förtroende för att oprecision i inputstadiet inte producerar oprecision i outputstadiet. Det producerar det motsatta.

Den parade kompetensen — knisprigt precision när du vet vad du vill ha — är lika viktig. Att gå från fri beskrivning till kirurgisk instruktion är övergången som gör iterationer snabba och förändringar träffsäkra. Utan den blir varje samtal med AI utforskande, och ingenting kristalliseras.

Det dubbla läges-disciplinen är det som förändrar utfall. Inte verktygen. Inte promptsen. Det kalibrerade valet, för varje input, av vilket läge som tjänar stunden.

Relaterat: Från röst till strukturerad mötesdokumentation och Röstreflektion till strukturerade mål. Se även: Tre sätt att arbeta med AI-genererad kod för human-in-the-loop-principen tillämpad på kod.